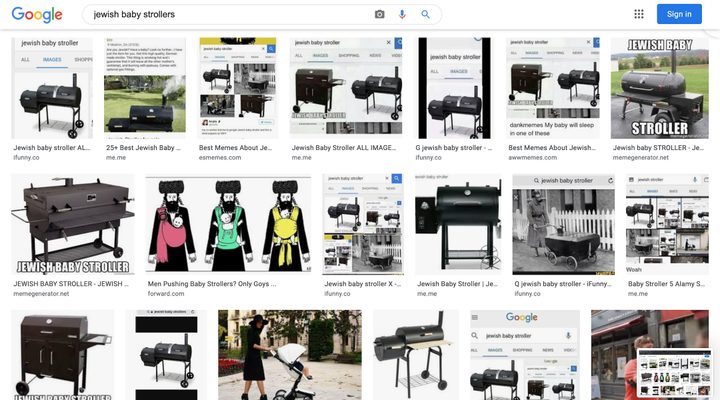

«Jewish baby strollers» –»coches de bebé judíos”, en español– es una frase que podría parecer inofensiva, pero está poniendo en serios aprietos al sistema de búsqueda de imágenes de Google.

Los resultados son impactantes e intolerables. Junto a bebés en carriolas, también aparecen asadores o barbacoas portátiles, en una ofensiva alusión al Holocausto, consigna la agencia Jewish Telegraphic (JTA) y que recogen medios como Xakata.

Aunque Google afirmó que está analizando la situación, los denunciantes creen que podría tratarse de una campaña orquestada por grupos antisemitas.

Engañando al algoritmo

La Network Contagion Research Institute es una organización que estudia cómo el discurso del odio se propaga en internet. Logró identificar la controvertida asociación entre el término y las imágenes en una serie de mensajes en foros de 4chan, que datan de 2017.

Según Joel Finkelstein, director del Instituto, cuando se hizo esta asociación por primera vez los autores podrían haber engañado al algoritmo de búsqueda de Google. «Engañan a Google para que ponga esas cosas en la parte superior. Pegan la imagen con las palabras para que cuando busques esas palabras, la imagen aparezca en la parte superior», afirma el investigador.

Según el organismo, las imágenes también podrían estar relacionadas con un meme antisemita que circuló en 2017, como parte de una campaña orquestada. «Es notable que la búsqueda de imágenes de Google no haya detectado eso”, advirtió Finkelstein.

Si fuera una «redada» -como se denominan estas campañas orquestadas-, no sería la primera de esta naturaleza.

La agencia JTA recuerda que en 2016, grupos antisemitas llevaron a cabo una operación en la que reemplazaron palabras por “Google” y el término «judíos» por “Skype», lo que habría obligado a Google a censurar su propio nombre.

Google, perturbado

Google se declaró perturbado con los resultados de las búsquedas, pero afirmó que son fruto del algoritmo.

“Entendemos que estos son resultados perturbadores y compartimos la preocupación por este contenido. No refleja nuestras opiniones”, dijo Google, en un comunicado a la agencia.

“Cuando las personas buscan imágenes en Google, nuestros sistemas se basan en gran medida en hacer coincidir las palabras de su consulta con las palabras que aparecen junto a las imágenes en la página web”, explicó.

Agregó que en este caso particular “que corresponde a un producto que en realidad no existe, las coincidencias más cercanas son las páginas web que contienen contenido ofensivo y de odio. Hemos realizado un trabajo considerable para mejorar los casos en los que devolvemos contenido de baja calidad y analizaremos esta situación para ver cómo podemos ofrecer resultados más útiles”.