La evolución de las cámaras de los smartphones evita que se produzcan los desenfoques o pixelaciones del pasado, y aunque al comienzo la calidad de estas imágenes no podían competir con las de las cámaras profesionales, hoy en día no son pocos los teléfonos que podrían filmar portadas de revistas. En rigor, no han pasado demasiados años, pero ¿eres realmente consciente de los avances logrados? Los asistentes de prueba de cámaras en DxOMark han estado probando cámaras de teléfonos inteligentes durante cinco años, y los resultados no dejan de sorprendernos.

¿Qué hace que las cámaras de teléfonos inteligentes de hoy sea tan capaces? DxOMark ha hablado de cinco tecnologías que han hecho posible que las cámaras de teléfonos inteligentes crezcan exponencialmente en los últimos cinco años.

¿Sabes cuáles son estas tecnologías?

Mejores procesadores

Definitivamente, un sensor de imagen no es nada sin el procesador conectado que funciona como una mini computadora, ya que convierte la señal del sensor en datos reales grabados. Los procesadores pueden hacer todo tipo de cosas, pero en general, cuanto más rápido sean, menos ruido (distorsión visual) agregarán a la imagen.

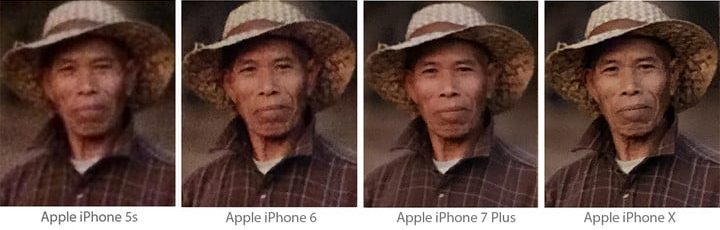

En cuanto a hardware, la única diferencia entre el iPhone 5s y el iPhone 6 fue solo un cambio en el procesador de señal de imagen, pero eso fue suficiente para que el iPhone 6 capturara imágenes con menos ruido.

Aunque el ruido es más evidente en entornos con poca luz, debemos tener en cuenta que, al existir menos ruido, existe más acceso a ver los detalles de una foto, especialmente cuando entra en juego la reducción de ruido digital.

Pero lo cierto es que no todos están de acuerdo en si es mejor menos ruido o más detalles; y un ejemplo de ello es lo que dice DxO sobre Google Pixel 2, ya que asegura que el creador de este dispositivo se equivocó al agregar más detalles con más grano, mientras que el Samsung Galaxy Note 8 ofrece menos granos, pero pierde más detalles en el proceso.

Imágenes HDR con múltiples disparos

Las cámaras de los teléfonos inteligentes no pueden adaptarse a los grandes sensores que usan las DSLR y las cámaras sin espejo. Pero para contrarrestar esto, usan trucos de software para producir imágenes de mayor calidad.

Y un ejemplo claro de esto son las imágenes de alto rango dinámico (HDR), que permiten que se graben múltiples imágenes a diferentes valores de exposición y se combinen en una sola. En la actualidad una cámara puede tomar tres fotos, una expuesta adecuadamente para las sombras, una para los medios tonos y otra para los aspectos más destacados, y luego fusionarlas en una fotografía que contiene detalles en un rango más amplio de oscuro a claro.

Sin embargo, vale la pena acotar que esto es un gran avance que se ha logrado con el tiempo y el desarrollo de la tecnología, ya que anteriormente este proceso estaba limitado a los programas de edición de imágenes de escritorio de gran impacto.

DxOMark asegura que desde que HDR apareció en los teléfonos inteligentes, la tecnología se ha acelerado en los últimos cinco años, lo que ha llevado a un crecimiento vertiginoso.

Asimismo, la detección facial es otra característica que ayuda a la exposición, ya que la cámara ahora sabe para qué parte de la imagen debe exponerse. Sin lugar a duda esta característica es la principal responsable de la gran evolución en calidad que se puede apreciar, si comparamos el iPhone 5s con los modelos más nuevos.

Mejoras en la estabilización

La estabilización en un teléfono inteligente no es nueva, pero ha cambiado drásticamente en los últimos cinco años, gracias a la integración de los datos de giroscopio en la función. Ahora, los algoritmos de estabilización requieren menos procesamiento y conjeturas que el uso del análisis de movimiento visual solo.

De igual forma DxOMark dice que otro gran avance que se ha podido observar es que la característica usa un segundo de video adicional como amortiguador para esperar realmente el tipo de movimiento que vendrá después.

Los teléfonos más recientes también emplean la estabilización de imagen óptica, en la que la lente o el sensor se mueve en contra del movimiento del teléfono. Esto ayuda a que se disimule considerablemente el movimiento de tu mano temblorosa sosteniendo el teléfono, y además da como resultado un video más fluido y fotografías más nítidas, especialmente en condiciones de poca luz, donde las velocidades de obturación lentas pueden producir desenfoque.

Enfoque automático más rápido

Cuando DxOMark comenzó a probar los teléfonos inteligentes, el iPhone 5s no ajustaba el foco después de que comenzaba un video. Ahora, gracias al enfoque automático de detección de fase en chip, el cual es un método de enfoque más avanzado que funciona sin ir y venir, las cámaras de los teléfonos pueden seguir el ritmo de los sujetos en movimiento mucho mejor y enfocarse continuamente.

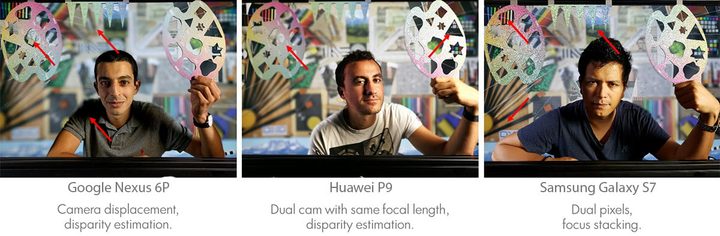

El Samsung Galaxy S7 utiliza lo que se conoce como un sistema de enfoque automático de doble píxel, el cual es una forma de detección de fase que funciona mejor con poca luz.

Pero Google intentó algo aún más único en el primer teléfono inteligente Pixel. Ese teléfono ilumina un rayo de luz sobre el sujeto y mide cuánto tarda la luz en regresar. Esto le dice a la cámara qué tan lejos está el sujeto para establecer un enfoque automático más preciso.

Sin embargo, una queja muy común que ha traído este método es que el tiempo de vuelo no funciona bien con luz brillante, por eso Google decidió tomar cartas en el asunto y agregó otra detección de fase que funciona como un segundo sistema de enfoque automático en su Pixel 2.

Lentes duales y fotografía computacional

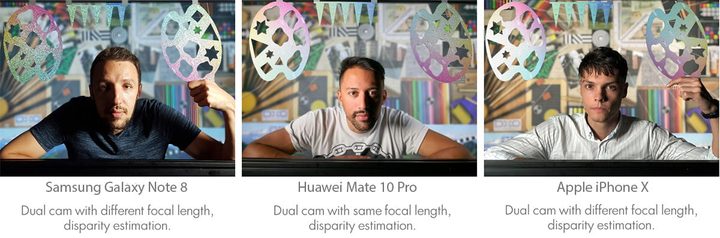

En los últimos años, muchos teléfonos no usan una, sino dos cámaras, con dos diferentes lentes y pares de sensores colocados uno al lado del otro.

El uso de estos lentes permite que el software cree un efecto conocido como profundidad de campo, donde el fondo se percibe borroso y se enfoca solo al sujeto. Aunque los primeros intentos que se hicieron de esta función fueron decentes, DxOMark asegura que las cámaras de la generación actual lo hacen aún mejor porque son más capaces de producir mapas de mejor profundidad, lo que reduce la cantidad de errores.

Sin embargo, DxO dice que esto es solo el inicio de todas las mejorías que veremos en las fotografías tomadas por los smartphones próximamente.

A medida que los teléfonos inteligentes tengan más habilidades, la fotografía computacional probablemente mejore, haciendo que las cámaras de los teléfonos sean más potentes y otorgando a los usuarios más control.

Aunque aún no ha sido posible, tal vez un día no muy lejano, un teléfono inteligente pueda reemplazar tu DSLR o cámara sin espejo.

*Actualizado por Daniel Matus el 15 de febrero de 2019.