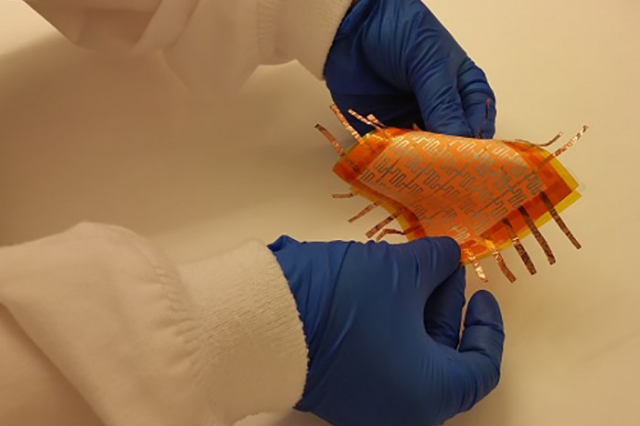

Esta plataforma de sensores, por cierto de bajo, puede detectar tacto, la presión, la temperatura, la acidez y la humedad. La piel de papel, como es llamada por los investigadores, se encuentra en las primeras etapas de desarrollo.

Relacionado: La bioimpresora 3D que fabrica tejidos humanos

El innovador material está hecho de artículos de la casa u oficina comunes, como papel de aluminio, papel de notas, esponjas y cinta adhesiva.

Los materiales se montan en una plataforma lisa, y una vez ensamblados, la piel de papel puede responder a estímulos externos tales como la humedad, cambios de temperatura, e incluso la presencia de un dedo.

El sistema se basa en la conducción eléctrica, detectando los estímulos externos producidos por la misma conductividad. Para detectar estos cambios, la piel está conectada a un dispositivo capaz de medir el voltaje, la resistencia y capacidad. Este sistema podría detectar estímulos múltiples simultáneamente en tiempo real.

El equipo utilizó los elementos individuales y combinados para imitar la función de la piel. Por ejemplo, la cinta adhesiva se utilizó para detectar la humedad, mientras que la esponja se utiliza para monitorear los cambios en la presión. Múltiples elementos tales como lápiz de plomo en papel y tinta de plata conductora sobre papel de aluminio se podrían usar para medir los estímulos más complejos tales como los niveles de acidez o cambios de temperatura.

Los investigadores KAUST esperan mejorar la piel de papel para que pueda ser utilizado como un dispositivo médico, el cual puede monitorear los signos vitales como la “frecuencia cardíaca, la presión arterial, los patrones de respiración y movimiento”, dijo Muhammad Mustafa Hussain representante del Laboratorio de Nanotecnología Integrado KAUST.

Antes de que el sistema se puede utilizar en un entorno clínico, el equipo tiene que llevar a cabo pruebas exhaustivas para determinar la fiabilidad a largo plazo del sistema. También tiene que medir la capacidad del papel para doblar y adherirse a la piel de un paciente. Además, los investigadores tendrán que desarrollar un sistema inalámbrico por lo que el papel se puede utilizar de modo autónomo, sin necesidad de una conexión directa a una máquina.

Según los investigadores de KAUST, la piel artificial es muy asequible, y funciona tan bien como versiones más costosas que también están es su fase de desarrollo. «Este trabajo tiene el potencial de revolucionar la industria de la electrónica y abre la puerta a la comercialización de dispositivos de detección de alto rendimiento asequible», dijo Hussain.