Llegará el momento que iremos para siempre con nuestros teléfonos por delante de nosotros… Bueno, actualmente ya casi es así, pero las nuevas funciones presentadas hoy en la Google I/O 2019 para Google Search y Google Lens están llevando las cosas todavía más lejos. O “más cerca”, quizá sería mejor decir.

¿Lo nuevo? Ahora Google Lens no solo podrá decirte qué cosa estás viendo a través de tu teléfono, sino que también traducirá para ti señales y carteles que estén en otro idioma, leyéndotelo en tu idioma, además. Y cuando encuentres determinados objetos en la búsqueda de Google (partes del cuerpo, animales, por ejemplo) podrás también verlos en el espacio que capta tu cámara.

¿Un juego más? Sí y no. Lo cierto es que poder ver como se mueven los músculos de tu cuerpo sobre tu escritorio, o apreciar las dimensiones bestiales de un tiburón blanco en tu sala de estar, no deja abrir utilidades pedagógicas. ¿Demasiado serio? Busca esas tenis que tanto deseas y, antes de comprarlas, ve a través de la cámara y la AR como combinarán con tus pantalones y camisas. Como la tecnología misma, no se trata de algo bueno o malo en sí, sino que dependerá del uso que le demos.

Lo que pasa es que vivimos en la era de la realidad visual, y Google entiende esto a la perfección. Nosotros mismos, muchas veces, no encontramos mejor manera de explicar algo que dibujarlo o mostrarlo. Esa es justamente la idea: usar la cámara, la visión artificial y la Realidad Aumentada (AR) para superponer la información y el contenido en tu propio entorno físico. ¿No podrás comprender lo que está delante de tus ojos, acaso? Seguro que sí.

Las nuevas funciones de AR en la búsqueda que se implementarán a finales de este mes, y con ellas podrás ver e interactuar con objetos 3D directamente desde la búsqueda, colocándolos directamente en su propio espacio, a escala y con lujo de detalles. Lo que te contábamos antes sobre el tiburón: tú puedes leer y hacerte una idea de este escualo de 18 pies de largo. Pero otra cosa muy distinta será verlo de cerca y en relación con las cosas que te rodean.

Por cierto, este tipo de tecnología no es nada si no cuenta con socios que sepan sacarle provecho. Para estas nuevas funciones Google ha trabajado con instituciones como la NASA, museos, fabricantes como New Balance, Samsung, tiendas como Target, Visible Body, Volvo, Wayfair y otros más. Las búsquedas en el futuro cercano no solo serán más rápidas, sino también más instructivas y entretenidas.

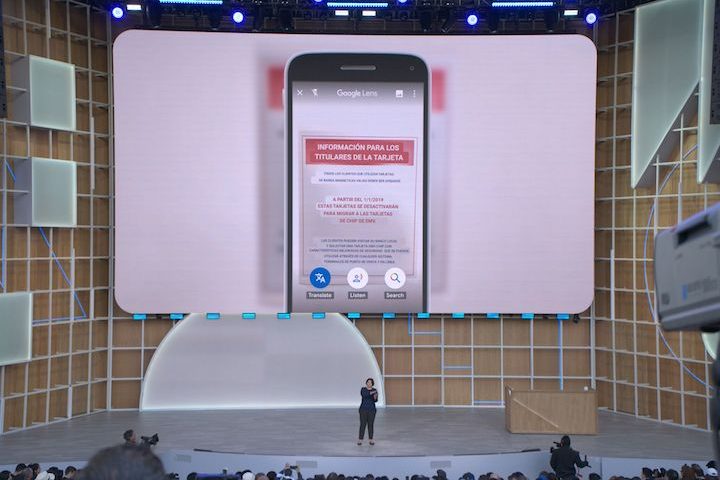

La gente ya le ha hecho a Google Lens más de mil millones de preguntas sobre las cosas que están viendo. Lens aprovecha el aprendizaje automático (ML), la visión por computadora y decenas de miles de millones de hechos en la Gráfica de conocimiento para responder estas preguntas. Ahora, la evolución de Lens proporcionará más respuestas visuales a preguntas visuales.

El ejemplo mostrado era sin duda el más clarificador. Estás en un restaurante, pensando qué pedir. Google Lens resaltará automáticamente los platos más populares en el menú físico –información que Google ya sabrá–. Cuando toques en un nombre, verás el plato en AR, así como lo que la gente opina al respecto, gracias a las fotos y las reseñas de Google Maps. Ya decían nuestras abuelas que la comida entra por la vista…

Google Lens te será particularmente útil cuando estés viajando por lugares con idiomas que no conoces. Podrás apuntar tu cámara hacia textos escritos, y Lens detectará automáticamente el idioma y superpondrá, traduciéndolo justo encima de las palabras originales. Se manejará en más de 100 idiomas, por lo que –a no ser que estés en algún lugar realmente exótico– no debieras tener problemas.

Google también ha dicho que está trabajando en otras formas de conectar información digital útil a cosas del mundo físico. Así, podrás usar Lens para ver historias ocultas sobre determinadas pinturas cuando vayas a un museo, por ejemplo. O si ves en la revista Bon Appetit un plato que te gustaría cocinar, podrás apuntar tu cámara a una receta y hacer que la página cobre vida y te muestre exactamente cómo cocinarlo.

En fin: las nuevas habilidades de Google Lens nos parecen a veces muy obvias, pero representan un desarrollo tecnológico de última generación en el que trabajan Google y otras empresas asociadas para hacer realidad lo más evidente: eso que está justo allí, ante nuestros ojos.