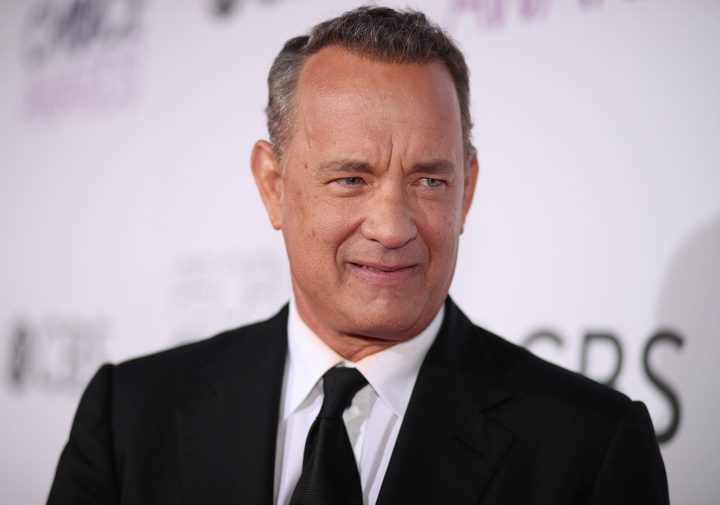

Tom Hanks debe ser de los actores más conocidos y legendarios de Hollywood, y el interprete de El Náufrago quiere seguir hablando con Wilson cuando esté muerto, ya que admitió en una entrevista que le gustaría perpetuar sus actuaciones en el cine gracias a la IA.

El actor conversó en el podcast del comediante Adam Buxton, donde el aclamado actor discutió sobre la posibilidad de continuar su carrera una vez que fallezca a través de los avances de inteligencia artificial. De hecho, contó que ya hay personas en la industria discutiendo los aspectos legales de “mi rostro y mi voz y todo los demás con respecto a nuestra propiedad intelectual”.

Según Hanks, todo comenzó cuando “prestó” su rostro para la película de Zemeckis, Polar Express: «entonces lo vimos venir. Vimos que iba a haber esta capacidad […] de tomar ceros y unos dentro de una computadora y convertirlos en una cara y un personaje. Ahora, eso solo se ha multiplicado por mil millones desde entonces y lo vemos en todos lados. Es una posibilidad de buena fe en este momento, si quisiera, podría reunirme y lanzar una serie de siete películas que me protagonizarían en las que tendría 32 años desde ahora hasta la llegada del reino».

Tom Hanks además recordó cómo en el cine se han usado ya técnicas para rejuvenecer a actores como Robert de Niro o Harrison Ford, o colocar a Carrie Fisher en Star Wars después de muerta.

“Cualquiera ahora puede recrearse a sí mismo a cualquier edad que tenga mediante inteligencia artificial o tecnología deepfake. Es más, podría ser atropellado por un autobús mañana y eso es todo, pero mis actuaciones pueden seguir y seguir y seguir. Y no habrá nada que les diga que no somos yo y solo yo”, zanjó en el podcast.