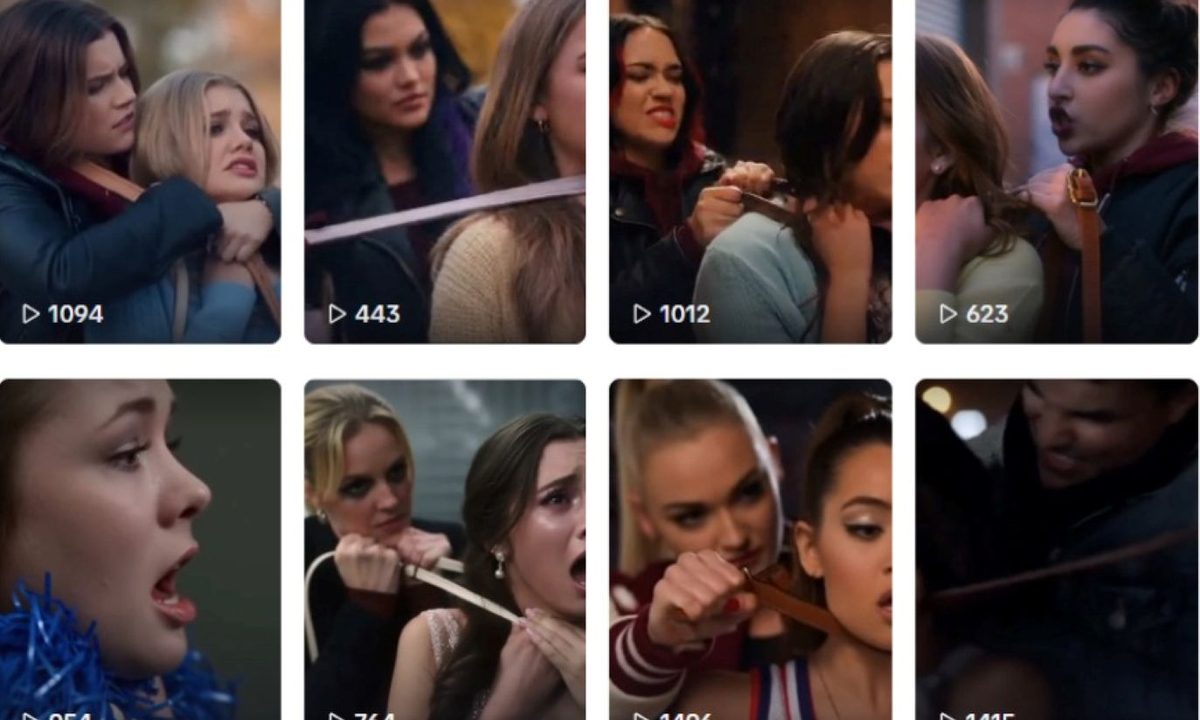

¿Qué pasó: Esto es bastante horrible. La gente está encontrando videos generados por IA en TikTok y X (la aplicación que todos todavía llamamos Twitter) que muestran a mujeres y niñas siendo estranguladas.

- Estos no son dibujos animados; se ven aterradoramente realistas. Los clips son cortos, tal vez 10 segundos, y tienen títulos horribles como «Una porrista adolescente fue estrangulada», que muestra a «mujeres» sintéticas llorando y luchando.

- Los investigadores señalan que muchos de estos videos tienen una marca de agua de Sora 2, el nuevo generador de video de OpenAI que acaba de lanzarse al público el 30 de septiembre. Algunas de las cargas más recientes no tienen la marca de agua, lo que es aún más aterrador: significa que las personas podrían estar descubriendo cómo eliminarla o que están usando otras herramientas de inteligencia artificial para hacer estas cosas.

- Las cuentas que los publican también son espeluznantes. El de X casi no tiene seguidores, mientras que uno similar en TikTok tenía más de 1,000 antes de que finalmente fuera eliminado. Parece que ambos comenzaron en octubre, primero publicando clips de televisión reales y luego… cambiaron a esta violencia generada por IA.

¿Por qué es importante? Esta es una gran señal de alerta. Muestra que estas plataformas de IA y sitios de redes sociales están fallando por completo en detectar estas cosas, incluso cuando sus propias reglas prohíben claramente el «contenido gráfico o violento».

- TikTok eliminó la cuenta después de que los medios comenzaran a hacer preguntas, pero según los informes, X acaba de… no lo hicieron, incluso después de que los usuarios lo informaran.

- También muestra el riesgo más oscuro de estas nuevas herramientas de IA, lo que significa que se está volviendo aterradoramente fácil para cualquiera crear videos hiperrealistas de violencia, especialmente contra mujeres y niños.

- Esto no es solo «romper las reglas»; es totalmente poco ético y plantea enormes preguntas legales sobre el uso de la IA para crear y compartir abusos.

Por qué debería importarme: Ahora que cualquiera puede hacer estas cosas, puede extenderse como un reguero de pólvora, haciendo que la gente se vuelva insensible a lo horrible que es realmente este tipo de violencia.

- Debe tener en cuenta que, aunque estos videos son «falsos», aún pueden causar un daño psicológico real y alimentar una cultura de violencia.

- Es solo otra llamada de atención masiva de que necesitamos desesperadamente salvaguardas más fuertes. Las empresas que construyen estas herramientas de IA y las plataformas que permiten que se propaguen deben rendir cuentas.

Lo que sigue: El gobierno del Reino Unido acaba de anunciar que se está moviendo para hacer ilegal cualquier representación pornográfica de estrangulamiento, lo que es una señal de que los países están comenzando a despertar a esto.

- Mientras tanto, aumenta la presión sobre OpenAI, TikTok y X para que actúen juntos y pongan barreras reales en sus herramientas de IA para que no puedan usarse para producir este tipo de basura perturbadora y violenta.