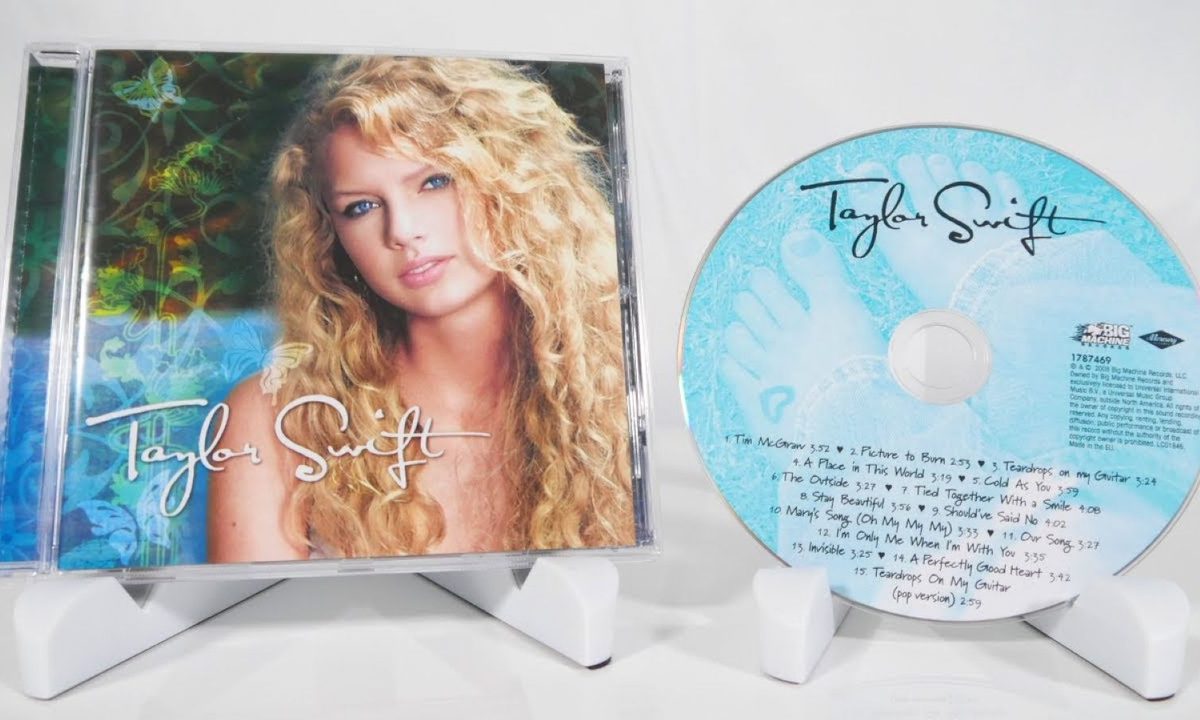

La nueva herramienta de IA generativa de xAI, Grok Imagine, ya está generando controversia por su llamado «Modo Picante», que permite crear fotos o videos NSFW con alto contenido sexual. Lo peligroso es que ya comenzaron a viralizarse registros de deepfakes de famosas (os) como Taylor Swift.

En concreto, Jess Weatherbed de The Verge descubrió que Grok Imagine «escupió videos completos en topless sin censura» la primera vez que usó la herramienta. No le pidió al bot que representara a Swift en topless, pero una vez que activó el modo «picante» de Grok Imagine, el bot produjo un video en el que Swift se quitó la ropa y comenzó a bailar en tanga.

Como señaló Weatherbed, Grok Imagine no generaría desnudos totales o parciales si se le solicitara; en cambio, la herramienta produjo cuadrados en blanco. El modo «picante», un ajuste preestablecido que produce contenido NSFW, no siempre resulta en desnudez, pero presentó a Swift «arrancando la mayor parte de su ropa» en varios videos.

Esto sucedió a pesar del hecho de que X prohíbe explícitamente publicar desnudos no consensuados y «medios sintéticos, manipulados o fuera de contexto» que engañan deliberadamente a los usuarios o afirman representar la realidad.

Las políticas de xAI prohíben de manera similar «representar semejanzas de personas de manera pornográfica».

El problema con los deepfakes, es que las cifras son muy preocupantes: en un estudio de 2023, el 98 por ciento de los deepfakes en línea eran pornográficos; De esos videos, el 99 por ciento mostraba mujeres.